stm32

内核开发

寒武纪笔试

特此声明

扩散模型

STM32CubeMX

html静态网页

qt5

栈

hdfs

组件封装

学生个人网页制作

医院运营

深度卷积神经网络

知识产权

xargs

IDEA 常用插件

DDD领域驱动设计

torch

TMS320F28335

CBAM

2024/4/24 10:05:44CBAM注意力机制详解(附pytorch复现)

简介

论文原址:1807.06521.pdf (arxiv.org)

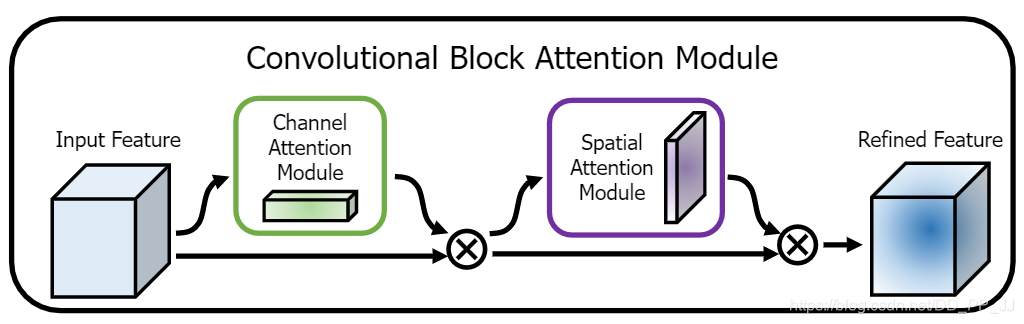

CBAM(Convolutional Block Attention Module)是一种卷积神经网络模块,旨在通过引入注意力机制来提升网络的表示能力。CBAM包含两个顺序子模块:通道注意力模块和空间注意力…

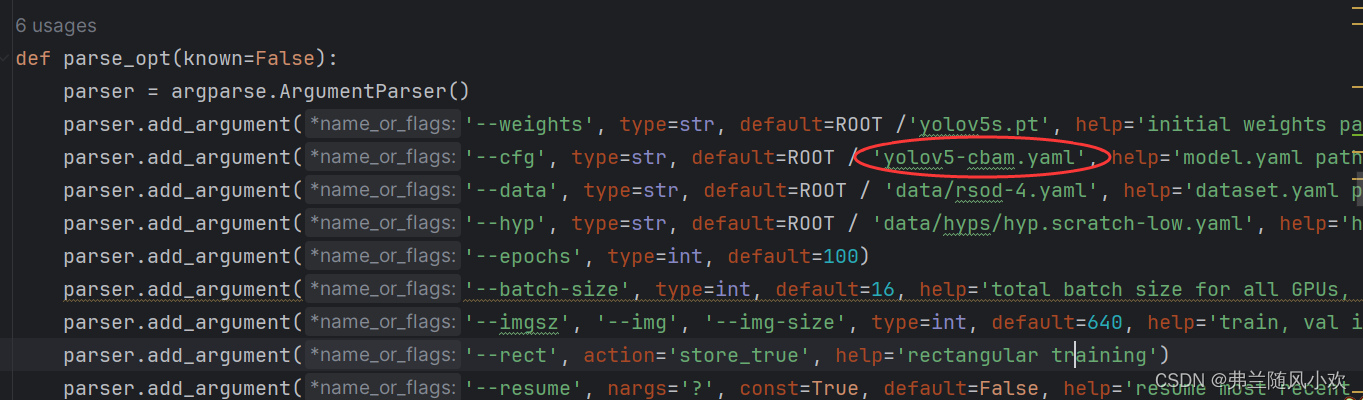

【目标检测实验系列】YOLOv5模型改进:融合混合注意力机制CBAM,关注通道和空间特征,助力模型高效涨点!(内含源代码,超详细改进代码流程)

自我介绍:本人硕士期间全程放养,目前成果:一篇北大核心CSCD录用,两篇中科院三区已见刊,一篇中科院四区在投。如何找创新点,如何放养过程厚积薄发,如何写中英论文,找期刊等等。本人后续会以自己实战经验详细…

CBAM:卷积注意力机制

文章目录 CBAM结构Channel attention moduleSpatial attention moduleArrangement of attention modules对比实验ablation对比实验通道注意力的avgpooling vs. maxpoolingSpatial attention对比实验Arrangement of the channel and spatial attention数据集验证ImageNet-1K可视…

Attention机制中CBAM以及Dual pooling的pytorch实现

前言:虽然会pytorch框架中的一些基础操作,但是有很多实现直接让自己写还是挺困难的。本次的代码参考senet中的channel-wise加权,CBAM中的channel-attention和spatial-attention, 另外还有kaggle Mastergray 分享的Dual pooling。由于没有特别…

【论文笔记】CBAM:Convolutional Block Attention Module(卷积块注意力模型)

本文是关于论文《CBAM: Convolutional Block Attention Module》的阅读笔记。 一、概述

深度学习中的注意力机制是模仿人类的注意力产生的,当我们在看一副图像时,图像中有些地方(比如人物照中的人的面部)会引起我们的注意力&…

CBAM: Convolutional Block Attention Module 卷积块注意模块详解

论文地址:https://arxiv.org/abs/1807.06521

1. 摘要

我们提出了卷积块注意模块 (CBAM), 一个简单而有效的注意模块的前馈卷积神经网络。给出了一个中间特征映射, 我们的模块按照两个独立的维度、通道和空间顺序推断出注意力映射, 然后将注意力映射相乘为自适应特…